앙상블 ★

- 여러 가지 예측 모형을 조합하여 전체적인 분산을 감소시키는 기법

- 성능 향상을 위한 기법

1) 보팅(Voting, 투표) : 다수결을 통해 모델을 선정

2) 배깅(Bagging)

: 복원추출에 기반을 둔 붓스트랩을 형성하여 학습한 후에 보팅으로 결합

: 복원추출은 데이터가 있을 때 값을 넣었다 뺏다 하면서 데이터셋을 형성

: 이 넣다 뺏다 하는 작업을 무한히 반복해도 특정 데이터가 선택되지 않을 확률이 36.8% ★

3) 부스팅(Boosting)

: 잘못 분류된 데이터에 높은 가중치는 주는 방법

: 이상치에 민감함

: 종류 - AdaBoost, GBM, XGBoost, Light GBM

4) 랜덤포레스트

: 배깅에 의사결정트리를 추가 - 성능이 좋아지고 이상치에 강한 모델이 됨

인공신경망

- 인간의 뇌를 표방함, 신경망 하나하나를 퍼셉트론이라고 부름

1) 구조

-. 단층 신경망 : 퍼셉트론이 하나밖에 없음, Input - O(퍼셉트론) - Output

-. 다층 신경망 : Input - O O O O - Output : 1개 이상의 은닉층 보유(다층 퍼셉트론)

-. 은닉층 수는 사용자가 직접 설정

-. 퍼셉트론은 선형회귀 모델로 되어있음 => 어차피 선형성을 띠는 한계가 있

2) 활성화 함수★

. 퍼셉트론이 선형회귀 모델이기 때문에 선형성의 한계가 있어 이를 극복하기 위함

①시그모이드 함수

: 0과 1 사이의 확률 값을 가짐, 로지스특 회귀 분석과 유사함

② 소프트맥스 함수

: 출력 값이 여러 개로 주어지고 목표 데이터가 여러 범주인 경우 활용한다

③ 하이퍼볼릭 탄젠트 함수

: -1과 1 사이의 값을 가짐, 시그모이드 함수의 최적화 지연을 해결하는 함수

④ ReLU 함수

: 기울기 소실문제를 극복함, max(0, x)

: 경사하강법을 사용할 때 너무 조금씩 내려가서 가중치가 변경되지 않을 때 ReLU로 극복

3) 학습방법

① 순전파 : 정보가 → 방향, 앞으로 전달

② 역전파 : 정보를 뒤로 전달하는 역전파, y=w1x1 + w2x2 일 때 w1, w2는 가중치(=회귀계수)

③ 경사하강법 : 오차가 최소가 되는 가중치(w1 = 회귀계수)를 구하기 위한 최적의 해를 찾는 기법

④ 기울기 소실 문제

: 시그모이드 함수를 사용하면 학습이 제대로 되지 않음

: 경사를 꾸준히 내려가서 오차가 최소가 되는 곳으로 내려가야 되는데 천천히 내려가서 가중치 갱신인 안됨

: 이럴 때는 ReLU 함수 사용해서 기울기 소실문제를 극복하기도 함

가중치의 오차를 최소로 줄이기 위해 노력해야 함

회귀분석에서는 오차를 줄이기 위해 : 최소제곱법을 사용 (이차함수)

인공신경망에서는 경사하강법을 사용

기타 분류모델

1) KNN : 인접에 많은 데이터가 포함되어 있는 범주로 분류함

2) 나이브베이즈 : 나이브는 독립, 베이즈 이론을 기반으로 범주에 속할 확률을 계산함

3) SVM : 선형이나 비선형 분류 혹은 회귀등에서 활용할 수 있는 모델

분류모델 평가지표

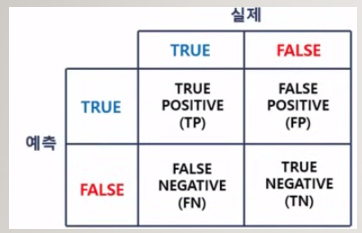

1) 오 분류표 ★

: 혼동행렬이라고도 함

: 표에 숫자들이 들어가고 숫자를 통해 평가지표 계산이 됨

1) 평가지표 ★ ★

: 오 분류표의 값들을 활용하여 평가지표의 값들을 구할 수 있어야 함

: 수식과 값들이 어디에 위치해 있는지 알아야 함

-. 재현율(Recall) : TP Rate , 민감도(Sensitivity), Hit Rate라고도 함

-. F-1 Score : Precision과 Recall의 조화 평균

'자격증 > ADsP' 카테고리의 다른 글

| ADsP 데이터분석 기출문제 : 이상치(outlier), pylr함수, sqldf 함수, 이상치판정법 (48) | 2024.05.07 |

|---|---|

| ADsP 3과목 기출문제 풀이 : EDA, 데이터 마이닝, 탐색적 데이터 분석, 데이터 처리구조, (8) | 2024.05.06 |

| ADsP 3과목 : 시계열 모형, 분해시계열, 과대적합, 과소적합, 의사결정트리 (2) | 2024.05.05 |

| ADsP 3과목 데이터 분석 : 가설검정, 회귀분석, ANOVA (7) | 2024.05.02 |

| ADsP 3과목 데이터 분석 : 표본 추출 방법, 자료의 척도, 기초 통계량, 첨도와 왜도 (2) | 2024.05.01 |